Plaki — Reconocimiento Inteligente de Placas

Optimiza el control de acceso y la seguridad con nuestra tecnología de reconocimiento automático de matrículas, diseñada para precisión en tiempo real.

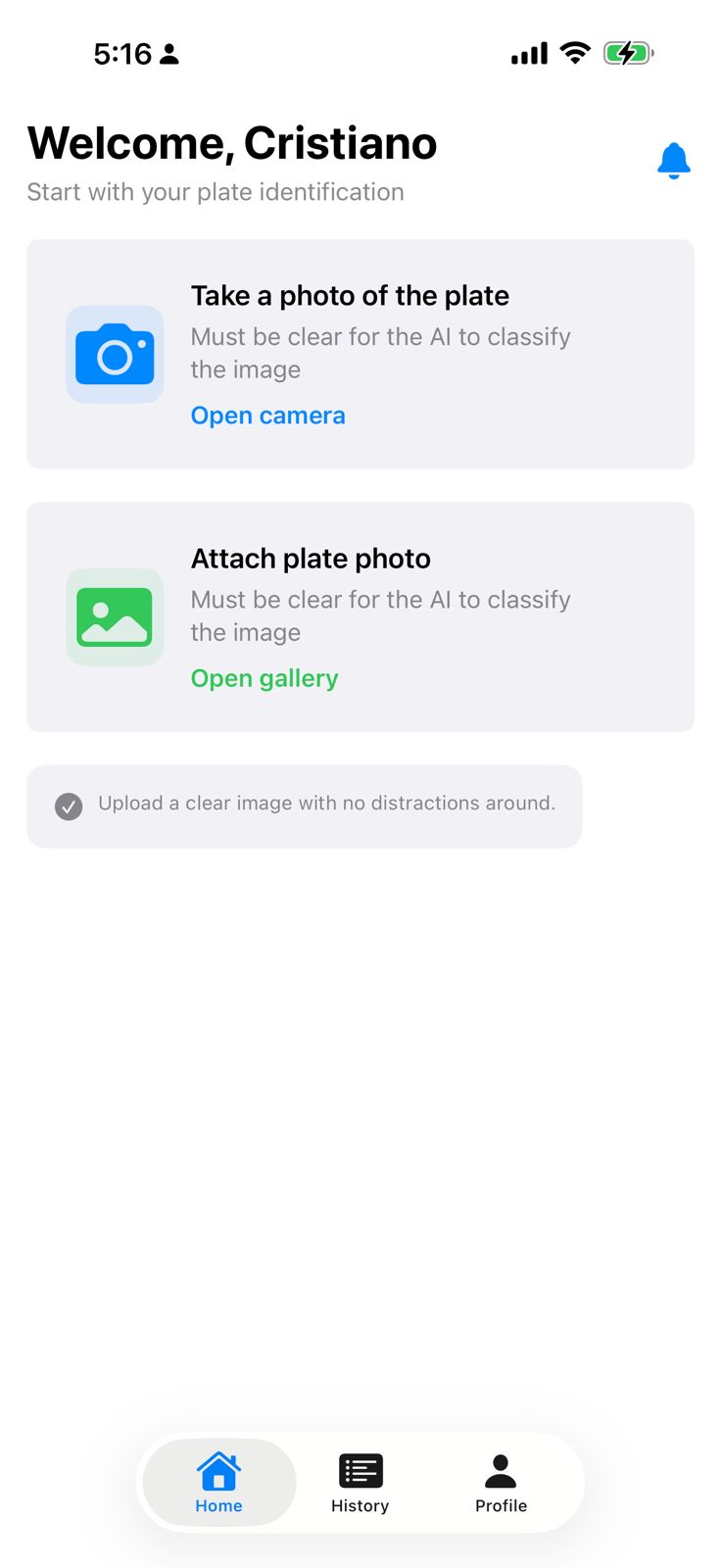

Flujos de la Aplicación

Explora las funcionalidades clave de Plaki, desde la autenticación segura hasta el escaneo en tiempo real.

Acceso Seguro de Doble Capa

Autenticación en dos etapas: Firebase Authentication verifica la identidad del usuario y genera un token cifrado que el backend empresarial valida antes de conceder acceso. Soporta login con email/contraseña y Google Sign-In mediante OAuth 2.0. El registro de nuevos operadores incluye creación automática de la cuenta en Firebase y el perfil en el backend.

- Autenticación Firebase + validación en backend empresarial

- Google Sign-In con OAuth 2.0 (sin contraseña)

- Registro de operadores con validación de datos en tiempo real

- Sesión persistente con token JWT renovable automáticamente

Estado del Modelo IA

Monitoreo en tiempo real del rendimiento de nuestros modelos de visión computacional.

Cómo Generamos Nuevos Modelos

Un pipeline automatizado que asegura la calidad y el despliegue continuo de mejoras en nuestros modelos de inteligencia artificial.

Flujo end-to-end según el Manual de Gobernanza de Datos – Pipeline de Curado y Entrenamiento: Aprobaciones PR → Merge → Recolecta RAW → Workflow → Preentreno/Curado → CURATED + Reportes → Vertex Training → Outputs.

El PR incluye bucket/prefix RAW y versión propuesta. Aprobación del Data Governor y checklist (fuente RAW, políticas de acceso, dominio permitido).

El merge a la rama principal es el disparador único del pipeline CI/CD. Desde este punto no se requieren ejecuciones manuales.

Consolidación del lote de imágenes en zona RAW (GCS). Lote inmutable y versionado: gs://bucket/raw/version/

Ejecución del workflow (image_ingestion_workflow.yaml). Lista objetos RAW y publica mensajes por imagen en Pub/Sub (step-1) para curado a escala.

Pre-entrenamiento: filtros de calidad (resolución, nitidez, exposición, ruido, artefactos). Salida separada físicamente del RAW.

Dataset CURATED (solo imágenes aprobadas) y reportes de curado (JSON/CSV). Ubicaciones: gs://bucket/curated/version/ y gs://bucket/reports/version/

Al finalizar el curado, el pipeline ejecuta el job de entrenamiento en Vertex AI con el dataset CURATED de la versión correspondiente.

Modelo entrenado, métricas (train/val/test), logs y metadatos del run (dataset version, commit, parámetros, timestamps). Trazabilidad por run_id.

El PR incluye bucket/prefix RAW y versión propuesta. Aprobación del Data Governor y checklist (fuente RAW, políticas de acceso, dominio permitido).

El merge a la rama principal es el disparador único del pipeline CI/CD. Desde este punto no se requieren ejecuciones manuales.

Consolidación del lote de imágenes en zona RAW (GCS). Lote inmutable y versionado: gs://bucket/raw/version/

Ejecución del workflow (image_ingestion_workflow.yaml). Lista objetos RAW y publica mensajes por imagen en Pub/Sub (step-1) para curado a escala.

Pre-entrenamiento: filtros de calidad (resolución, nitidez, exposición, ruido, artefactos). Salida separada físicamente del RAW.

Dataset CURATED (solo imágenes aprobadas) y reportes de curado (JSON/CSV). Ubicaciones: gs://bucket/curated/version/ y gs://bucket/reports/version/

Al finalizar el curado, el pipeline ejecuta el job de entrenamiento en Vertex AI con el dataset CURATED de la versión correspondiente.

Modelo entrenado, métricas (train/val/test), logs y metadatos del run (dataset version, commit, parámetros, timestamps). Trazabilidad por run_id.

Quality Gates

Cada modelo pasa por estrictos controles de calidad automatizados. Si la precisión cae por debajo del umbral establecido, el despliegue se detiene automáticamente.

Entrenamiento Continuo

El sistema identifica automáticamente casos de baja confianza ("Edge Cases") y los reincorpora al dataset de entrenamiento para mejorar continuamente el modelo. Trazabilidad completa por run_id y versión.

Toda ejecución se identifica por versión de dataset y run_id — garantizando reproducibilidad y auditoría de extremo a extremo en Google Cloud Platform (us-central1).